MagicAnimate 旨在对遵循运动序列的参考图像进行动画处理,并具有时间一致性。

应用领域

将油画和电影人物等看不见的领域图像动画化,以进行跑步或瑜伽。

对 DALLE3 生成的参考图像进行动画处理以执行各种操作。

按照给定的动作制作多人动画。

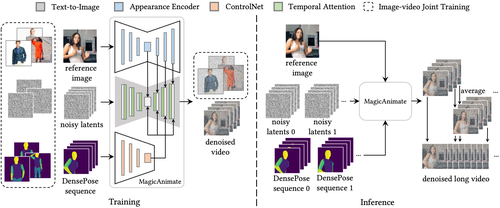

pipeline架构

给定参考图像和目标 DensePose 运动序列,MagicAnimate 采用视频扩散模型和外观编码器分别进行时间建模和身份保留(左图)。为了支持长视频动画,我们设计了一种简单的视频融合策略,可以在推理过程中产生平滑的视频过渡(右图)。

开始使用

下载StableDiffusion V1.5和MSE-finetuned VAE的预训练基础模型。

下载我们的 MagicAnimate检查点(checkpoint)。

请按照huggingface下载说明下载以上模型和检查点,推荐用git lfs。

按如下方式放置基础模型和检查点:

magic-animate

|----pretrained_models

|----MagicAnimate

|----appearance_encoder

|----diffusion_pytorch_model.safetensors

|----config.json

|----densepose_controlnet

|----diffusion_pytorch_model.safetensors

|----config.json

|----temporal_attention

|----temporal_attention.ckpt

|----sd-vae-ft-mse

|----config.json

|----diffusion_pytorch_model.safetensors

|----stable-diffusion-v1-5

|----scheduler

|----scheduler_config.json

|----text_encoder

|----config.json

|----pytorch_model.bin

|----tokenizer (all)

|----unet

|----diffusion_pytorch_model.bin

|----config.json

|----v1-5-pruned-emaonly.safetensors

|----...安装

先决条件:python>=3.8、CUDA>=11.3、 和ffmpeg。

安装conda:

conda env create -f environment.yaml conda activate manimate

或者pip:

pip3 install -r requirements.txt

推理

在单个 GPU 上运行推理:

bash scripts/animate.sh

使用多个 GPU 运行推理:

bash scripts/animate_dist.sh

Gradio演示

在线gradio演示:

快速体验我们的在线gradio演示。

本地gradio演示:

在单 GPU 上启动本地 gradio 演示:

python3 -m demo.gradio_animate

如果您有多个 GPU,可以这样启动本地 gradio演示:

python3 -m demo.gradio_animate_dist

然后在本地浏览器中打开gradio演示。